Das ZIM macht das Telefonbuch der Bergischen Universität noch nutzerfreundlicher. Seit einiger Zeit können alle Einträge als vCard heruntergeladen werden und die Suchfunktion läuft über die BUW‑API, wodurch eine verbesserte Suche möglich ist.

Was ist eine vCard?

Eine vCard ist ein standardisiertes digitales Visitenkarten‑Format (Dateiendung .vcf). Sie fasst die wichtigsten Kontaktdaten – Namen, Position, E‑Mail, Telefon, Web‑Link usw. – in einer einzigen Datei zusammen. Mit einem Klick lässt sich die vCard in jedes gängige Adressbuch (Outlook, Gmail, das Smartphone‑Kontakte‑App …) importieren – kein mühsames Übertragen von Daten mehr.

Unterstützte Felder im BUW‑Telefonbuch

Beim Export wird die vCard nach dem nachfolgenden Schema aufgebaut:

BEGIN:VCARD

VERSION:3.0

FN: <-- Vollständiger Name

N: <-- Nachname;Vorname;weitere Vornamen;Präfix;Suffix

ORG: <-- Organisation / Abteilung

EMAIL;TYPE=INTERNET,WORK: <-- E‑Mail-Adresse

TEL;TYPE=WORK: <-- Telefon

URL: <-- Persönliche oder institutionelle Webseite

END:VCARDBeispiel‑vCard – Testdaten

Um zu zeigen, wie das Ergebnis aussieht, haben wir eine fiktive vCard einer klar erkennbaren Persönlichkeit aus der Informatik erstellt (hier: Alan Turing – natürlich nur als Test‑Datensatz). Alle Angaben sind rein illustrativ.

BEGIN:VCARD

VERSION:3.0

FN:Alan Mathison Turing

N:Turing;Alan;Mathison;;

ORG:University of Cambridge;Department of Computer Science;

EMAIL;TYPE=INTERNET,WORK:alan.turing@cam.ac.uk

TEL;TYPE=WORK:+44 1223 337000

URL:http://www.example.com/alan-turing

END:VCARDHinweis: Beim wirklichen Einsatz werden natürlich die tatsächlichen Kontaktdaten der jeweiligen Uni‑Mitarbeitenden bzw. Einrichtungen eingebettet – nicht die oben gezeigten Testdaten.

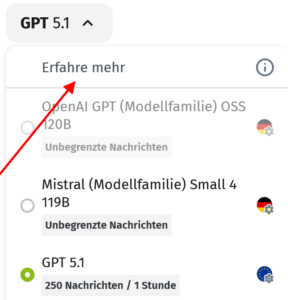

Verbesserte Suche über die BUW‑API

Die interne Suche des Telefonbuchs nutzt jetzt die BUW‑API:

https://zim.uni-wuppertal.de/de/unsere-dienste/buw-api

Durch die Anbindung an die API werden Anfragen direkt weitergeleitet. Das Ergebnis:

- Kürzere Antwortzeiten – Sie erhalten Treffer fast in Echtzeit.

- Bessere Trefferqualität – Die API berücksichtigt aktuelle Änderungen sofort.

- Verbesserte Suche nach Namen mit Umlauten – Die Suche berücksichtigt die verschiedene Schreibweise von Umlauten (oe bzw. ö) in Namen.

Uni-interne vs. weltweit verfügbare Einträge

Wir behalten weiterhin die klare Trennung zwischen:

| Kategorie | Wer kann sehen? |

|---|---|

| Interne Einträge | Nur Mitglieder der BUW (Studierende, Mitarbeitende) aus dem Uni-Netz |

| Weltweit verfügbare Einträge | Jeder Internetnutzer |

Diese Aufteilung sorgt dafür, dass sensible Daten geschützt bleiben, während gleichzeitig wichtige öffentliche Kontakte schnell gefunden werden können.